Risques démesurés de l'intelligence artificielle à l’avenir

Risques démesurés de l'intelligence artificielle à l’avenir

Les progrès de l'intelligence artificielle inquiètent de grands scientifiques, à commencer par le physicien Stephen Hawking qui estime que cela pourrait "mettre fin à l'humanité". L’intelligence artificielle peut outrepasser ses fonctions et devenir nuisible à l’homme, elle peut représenter un véritable danger.

De nouvelles voix se font entendre à l'encontre du développement massif des intelligences artificielles et des robots. Un regroupement de scientifiques britanniques s'interroge aujourd'hui sur l'avenir de l'homme dans ces conditions.

Et oui le sujet de l'intelligence artificielle concentre les attentions des chercheurs, convaincus que le risque zéro n'existe pas et que son développement pourrait à la fois se faire sans le concours de l'homme, mais également aux dépens de l'humanité.

Simple mise en garde ou paranoïa démesurée, difficile de rester rationnel tant il est facile de comparer l'étude aux scénarios des films de science-fiction. Néanmoins la situation est actuellement jugée sérieuse par un ensemble de scientifiques et d'ingénieurs du monde entier.

À n'en pas douter, l'homme devra imposer des limites à l'évolution de l'intelligence artificielle, ou l'encadrer par des lois et règles strictes. L'anticipation de ces mesures de sécurité est une demande aujourd'hui claire de la communauté scientifique aux gouvernements.

Ce risque est un risque sérieux car sans nous en rendre compte, la machine est déjà au-dessus de l’homme. Si le but premier est de doter la machine de conscience, alors ne se rendra-t-elle pas compte de sa condition ? Alors on peut envisager qu’elle se « rebellera » contre l’homme car elle se sentira exploitée. Les conséquences pourraient être dramatiques.

Ce risque est très faible mais il existe quand même.

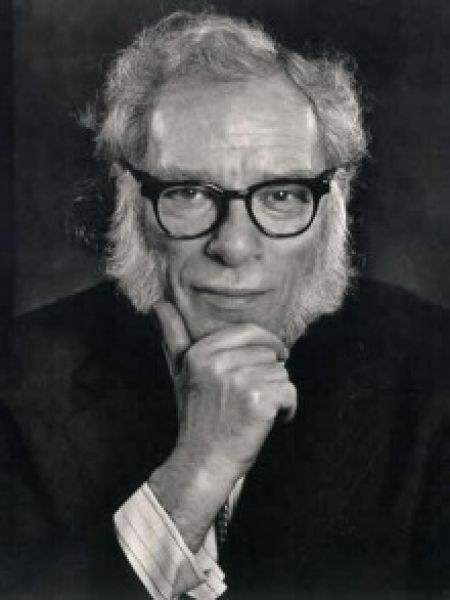

Il est donc important de pouvoir neutraliser ces machines. Pour prévenir ces risques, Isaac Asimov a énoncé des lois :

· Première Loi : Un robot ne peut porter atteinte à un être humain ni, restant passif, laisser cet être humain exposé au danger.

· Deuxième Loi : Un robot doit obéir aux ordres donnés par les êtres humains, sauf si de tels ordres sont en contradiction avec la Première Loi

· Troisième Loi : Un robot doit protéger son existence dans la mesure où cette protec-tion n'entre pas en contradiction avec la Première ou la Deuxième Loi.

· Il ajoute ensuite une loi 0 : "Un robot ne peut pas faire de mal à l'humanité, ni, par son inaction, permettre que l'humanité soit blessée."

« Supposons qu'existe une machine surpassant en intelligence tout ce dont est capable un homme, aussi brillant soit-il. La conception de telles machines faisant partie des activités intellectuelles, cette machine pourrait à son tour créer des machines meilleures qu'elle-même ; cela aurait sans nul doute pour effet une réaction en chaîne de développement de l'intelligence, pendant que l'intelligence humaine resterait presque sur place. Il en résulte que la machine ultra intelligente sera la dernière invention que l'homme aura besoin de faire, à condition que ladite machine soit assez docile pour constamment lui obéir ».